如果你对新车长期保持关注,就会发现近些年发布的智能车,在提到自动驾驶时,大概率会将自动驾驶芯片一块带上宣传。说到底,对于自动驾驶而言,一块性能足够强的芯片,就意味着车辆的自动驾驶系统可以“为所欲为”吗?

汽车芯片之变

近半年来,汽车芯片短缺的问题被逐步放大,演变至今,不少车企都只能通过减产甚至停产来过渡。

对于汽车来说,芯片有多重要呢?

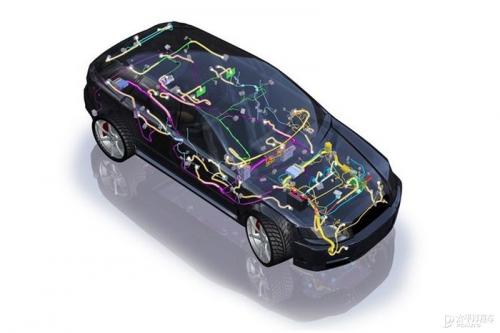

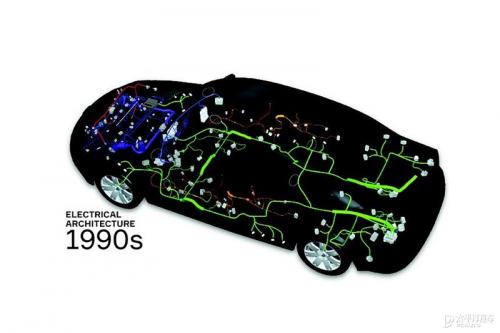

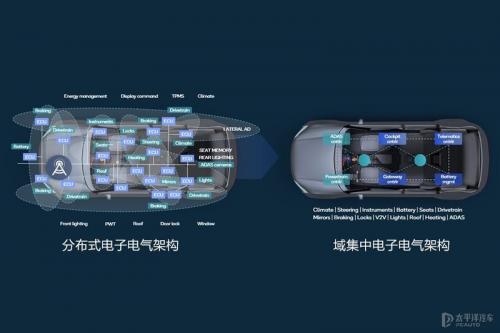

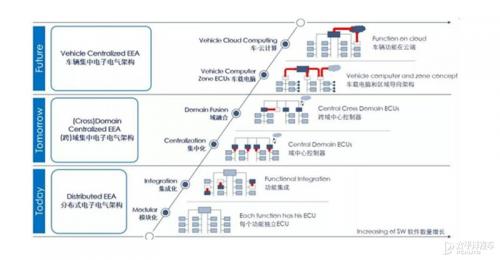

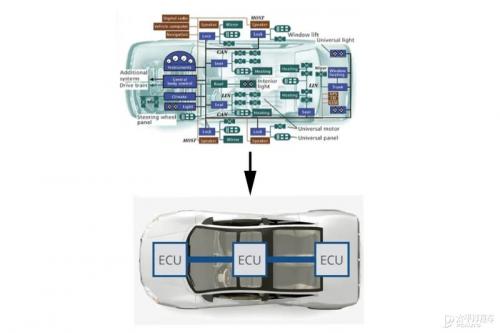

在传统的车型中,基本都是使用分布式的电子电气架构。也就是会根据功能划分模块领域,例如发动机、变速器、电子稳定控制系统、空调系统等等。每个功能模块的ECU都是基于对应功能而设定的,最后通过CAN总线传递信息,实现整车功能。

这样的架构功能划分清晰,并且供应商也能够有针对性地进行开发和研究。但这样的架构会导致模块太多,并且可控性可拓展性都较弱。在90年代初,一辆汽车上平均的MCU数量不足10个,而现在一辆车的MCU就超过了100个,高端车型的MCU可能还会达到300个。在汽车功能发展越来越繁多复杂时,车内所需要的控制器也越来越多。面对这种进化,传统的电子电气架构ECU和线束的数量都会大幅增长,并且传统架构下数据传输、ECU功能协同能力较差。

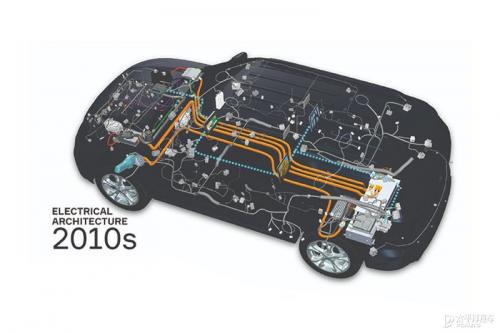

这个时候就需要一套新的电子电气架构来适应时代的发展。

集中式电子电气架构就此诞生。当下车企主要是采用域集中的概念来对电子电气架构进行优化,跟车汽车电子部件功能将整车划分为动力总成、车辆安全、车身电子、智能座舱、智能驾驶等几个域,使用处理能力更强的芯片去集中控制每个域。这样可以降低ECU的使用量,并且提升整车的可拓展能力。

特斯拉则是比较激进,以Model 3为例,整车采用了CCM、CEM R、CEM L三个主控制器,这样的方案属于中央处理器架构。其中CCM是自动驾驶及娱乐控制模块、CEM R是右车身控制器、CEM L是左车身控制器。通过这样极简的架构,控制器数量大幅减少,软件的集成度和整车的扩展性都得到了大幅提升。其实这点才是特斯拉真正领先于其他车企的地方。

而汽车电子电子架构目前的终极形态是形成一个超级中央计算机,通过中央集中式架构,实现计算集中化。这样整车的芯片和线束数量都得到了简化,整车的成本会随之降低,整车的资源利用及统筹也会更为彻底,有利于新技术快速落地。另外,这样的架构也会让车辆的软件研发主导权回归到车企和产品本身,而非头部的供应商,这样也有利于车企们研发出差异化的产品。

但无论是传统的分布式架构或是未来的中央集中式架构,芯片都是不可或缺的硬件。以往对芯片算力和集成度要求不高,未来ECU数量减少,就会对集中控制的ECU芯片有更高的要求,包括算力、功耗、成本等等。

自动驾驶芯片的演化

在智能汽车中,因为功能的多样性和复杂性,对芯片的要求会更高。尤其是在座舱系统和自动驾驶这两个部分,这也是近年来我们经常会在新车发布会上看到厂方宣传自家产品用了最新芯片的原因。而在这两部分中,自动驾驶系统对芯片的要求会更高,因为自动驾驶系统拥有数十个传感器,芯片要将这些数据“吞下”进行计算,最后得出决策,这对芯片的算力要求是非常高的。所以无论是特斯拉还是当下的头部车企,自动驾驶部分,始终是一个独立的控制域。

ADAS(Advanced Driving Assistance System)驾驶辅助系统早在数十年前就开始研究。按照美国汽车工程学会SEA对自动驾驶水平的划分(L0-L5),早期的自动驾驶技术都在L1-L2内,具体的功能包括了自适应巡航、车道偏离提示、车道保持、盲区监测、主动刹车等等。

对于跟车、主动刹车等功能,厂商或供应商们会选择使用毫米波雷达作为硬件,通过雷达测算出前车的距离以及速度,感知到的数据会在芯片中进行计算分析,最终实现自适应巡航等功能。

以Mobileye为代表的企业,则是以摄像头作为硬件,感知前方车辆以及道路标线,将采集到的画面传输到芯片分析后,获得自适应巡航、车道保持、主动刹车等功能。

而当下更为常见的硬件方案是毫米波雷达+摄像头,通过两种传感器的融合,可以实现更高级的功能,例如集成式智能巡航等功能。而这样的硬件架构下,厂商通常会选择一个传感器作为主控制器,再接受另外一个传感器的数据,最后进行统一的计算分析。

无论是单毫米波雷达、摄像头或是雷达+摄像头的硬件方案,它们的分析数据、场景都是固定的,所以对芯片的能力要求并不太高,只需要满足特定的计算分析即可。

这种环境下,大部分车企会选用Mobileye提供的视觉感知方案,因为Mobileye拥有从摄像头到芯片和算法的完整视觉驾驶辅助解决方案。而毫米波雷达则会选用大陆、博世等头部供应商产品,雷达内部计算芯片则来自赛灵思。

如果说自动驾驶辅助功能就此停留在这个阶段的话,那就没有当下自动驾驶芯片争斗的故事了。

可偏偏一条鲶鱼——特斯拉的出现,加速了自动驾驶领域的演变和进化。

特斯拉在2014年推出Model S时,搭载的是Mobileye的EyeQ3驾驶辅助芯片,并且摄像头等硬件也都是由Mobileye提供的。但Mobileye挤牙膏的视觉感知方案并不能满足激进的特斯拉,二者从技术路线的布局就有分歧。

在2016年1月份,一辆Model S在美国公路开启Autopilot行驶时,撞上了一台横过马路的白色货柜车,导致车主Joshua Brown当场死亡。这个事故Mobileye认为它们的驾驶辅助方案本来就有限定使用场景,而特斯拉激进的开放权限和过度的宣传,导致了驾驶员以为系统能够实现全自动驾驶功能。特斯拉方面则是认为这个事故是雷达和摄像头的识别错误,认为Mobileye方案还不够完善。

原本就有技术分歧,加上后来的死亡事故,让特斯拉和Mobileye在2016年7月宣布分手,特斯拉在此后的新车不会使用Mobileye的EyeQ4芯片。

特斯拉下一个合作的对象是Nvidia英伟达。

英伟达在2015年推出了基于Tegra X1的Drive PX自动驾驶芯片。Drive PX相比以往的驾驶辅助芯片区别在于它使用了深度神经学习技术,Drive PX可以从激光雷达、毫米波雷达、摄像头等传感器中获取数据,然后利用深度学习实现动态识别包括行人、汽车、路标等各类对象。

特斯拉看中英伟达Drive PX的正是它的深度学习技术。

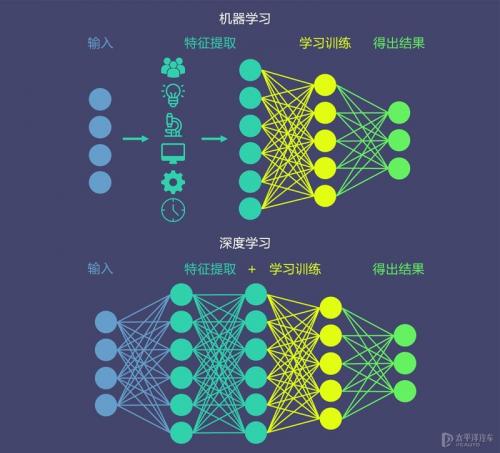

深度学习实际上是人工智能的一个分支,也是机器学习下的一个子集。学术点来说,深度学习是用于建立、模拟人脑进行分析学习的神经网络,并模仿人脑的机制来解释数据的一种机器学习技术。简单点来看,深度学习是用多层次的分析和计算手段得到结果的一种方法。深度学习最显著的应用是计算机视觉和自然语言处理领域。

在传统算法中,人脸识别、物体检测、物体跟踪以及行为预测都是比较难计算解决的。深度学习通过卷积神经网络模拟人脑,可以实现对人脸、车或其他物体的识别。而深度学习这样的能力对自动驾驶是有很大帮助的,通过深度学习技术,可以让自动驾驶系统拥有更强大的障碍物识别能力,并且厂商还能在云平台进行数据学习升级,再OTA提升车辆的自动驾驶能力。

Drive PX发布时,英伟达老板黄仁勋就表示,Drive PX可以从道路行驶中的车辆上获取数据反馈,从而帮助完善深度神经网络。当在路上工作的Drive PX系统遇到无法识别的物体时,它会通过网络传输到云后台,对应的团队会利用深度学习技术训练系统认知理解这个新图像,并且将学习到的数据实时反馈到所有量产车的Drive PX中,让车辆的自动驾驶能力得到实时的提升。

2016年10月,特斯拉正式宣布,Model S、Model X和当时即将推出的Model 3都会搭载英伟达DRIVE PX 2 AI计算平台,这个自动驾驶平台使用了特斯拉开发的神经网络。

使用DRIVE PX 2芯片后,特斯拉就在开始推出了测试版的高速导航自动驾驶辅助功能,2018年这项功能正式实现推送使用。

显然,深度学习技术,让特斯拉自动驾驶进展大大提速。而这个改变,也让自动驾驶芯片供应链产生了变化:

第一点是越来越多车企开始采用自动驾驶域控制器的玩法,也就是将雷达、摄像头等数据直接传递到自动驾驶域控制器内进行统一处理和计算,这样传统在雷达和摄像头中的计算芯片也就不在需要。

第二点是由于自动驾驶硬件中的数据都直接传输到自动驾驶域控制器中,这对于自动驾驶域控制器的大脑也就是芯片的算力有了更高的要求。

第三点是自动驾驶功能开始往更高级别发展,这其中脱离不了AI人工智能的技术辅助,这对芯片企业和车企都有了新的门槛。

在此后,芯片巨头们开始陆续入局自动驾驶,几乎每年都会有新芯片、新平台迭代推出,自动驾驶芯片也开始在算力上较劲。

扫一扫关注微信

扫一扫关注微信